在线av pig 视觉场景刻画偏激效果评价

视觉场景刻画技艺通过对输入图像或视频的内容分析在线av pig, 自动生成一个语句或几许语句的气象对视觉场景中的内容进行刻画, 属于谈论机视觉、多媒体、东说念主工智能和当然讲话处理等领域的交叉性研究课题.视觉场景刻画问题可归结为视觉语义意会、多媒体语义学习、场景意会等领域中的子问题, 其历史可雅致到多模态检索、跨模态学习等问题的研究.

连年来, 成绩于深度学习联系模子、方法的大意性进展和大样本数据集的出现, 尤其是跟着MS COCO、Flickr等基准数据集的出现和深度学习框架下卷积神经集聚(convolution neural network, 简称CNN)、轮回神经集聚(recurrent neural network, 简称RNN)、短永劫牵挂集聚(long short-term memory, 简称LSTM)等深度集聚模子研究的日益老练, 视觉场景刻画技艺再度掀翻研究激越, 并正在变为现实.关联词, 由于视觉场景中呈现内容的丰富性和当然讲话抒发的气象千般性, 使得视觉场景刻画成为一项复杂而富于变化的挑战性任务.

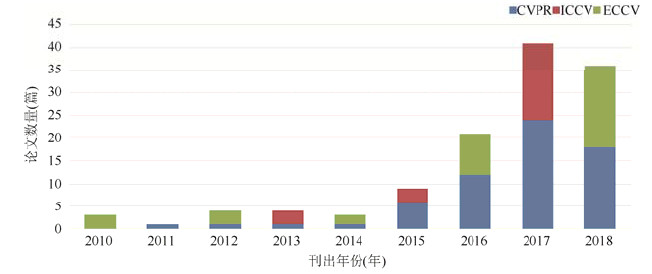

视觉场景刻画问题在业界和学术界均引起了高度爱好, 国表里联系研究机构包括Google实验室、Baidu研究院、微软研究院、中国科学院、斯坦福大学、伯克利大学、加利福尼亚大学等.在海外着名的学术论文藏书楼ACM、IEEE、Elsevier、Springer和国表里学术论文搜索引擎Google Scholar和百度学术中, 以“image description、video description、image captioning或video captioning”等为要道字, 检索论文, 其扫尾标明:连年来, 与视觉场景刻画研究的学术论文发表数量一直呈增长趋势, 反应最新后果的一系列论文在许多着名海外会议中如棋布星罗般产生.举例, “谈论机视觉与模式识别海外会议(IEEE Conf. on Computer Vision and Pattern Recognition, 简称CVPR)”[1-22]、“谈论机视觉海外会议(IEEE Int’l Conf. on Computer Vision, 简称ICCV)”[23-33]、“欧洲谈论机视觉会议(European Conf. on Computer Vision, 简称ECCV)”[34-40]、“神经信息处理系统海外会议(Int’l Conf. on Neural Information Processing Systems, 简称NIPS)”[41-49]和“当然讲话处理海外会议(Int’l Joint Conf. on Natural Language Processing, 简称NLP)”[50,51]等.

图 1所示为连年来对于“视觉场景刻画”在谈论机视觉领域中三大会议上论文发表数量的统计图, 直不雅地展现了该技艺的研究趋势.这些研究后果不仅股东了谈论机视觉、当然讲话处理等联系学科的和会发展, 况兼展现了其在视觉信息联系的跨模态检索、智能监控、海量数据压缩、匡助视觉防止东说念主士感知与意会周围环境等稠密领域的潜在应用.

Fig. 1 Papers on visual scene description published in the proceedings of three top conferences

图 1 三大顶级会议对于“视觉场景刻画”论文的发神志况

Fig. 1 Papers on visual scene description published in the proceedings of three top conferences

图 1 三大顶级会议对于“视觉场景刻画”论文的发神志况

本文综述视觉场景刻画偏激效果评价的研究近况和进展.具体来说, 第1节证明视觉场景刻画的界说、研究任务, 简要分析视觉场景刻画与跨模态学习、场景意会等联系技艺的关系.第2节分类回来视觉场景刻画的主要方法、模子及研究后果.第3节整理可用于图像刻画和视频刻画研究与竞技的基准数据集.第4节征询客不雅评价视觉场景刻画效果的主要方针、方法和存在的问题.临了, 第5节瞻望视觉场景刻画的应用前程.

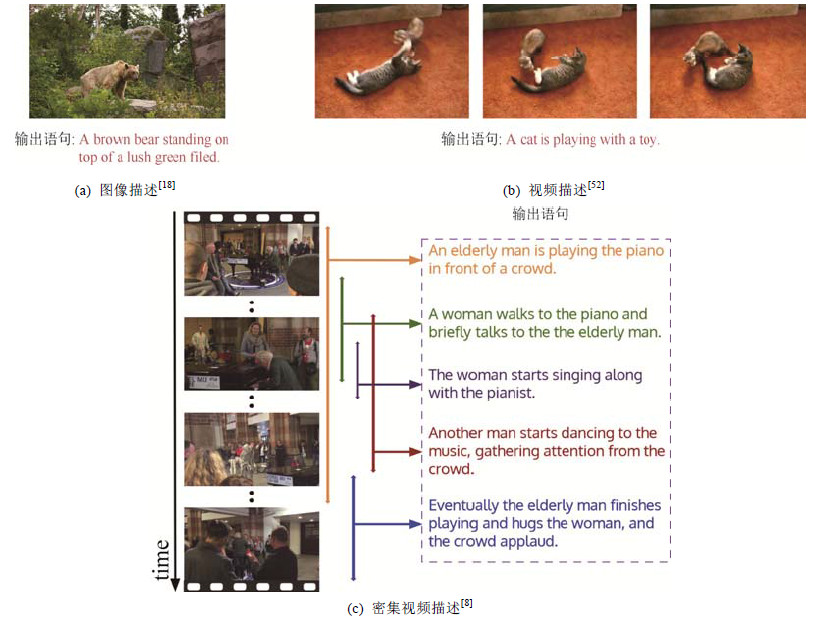

1 视觉场景刻画 1.1 界说与研究内容视觉场景刻画是指用谈论机视觉技艺模拟东说念主眼不雅察到一幅静态图像或不雅看了一段视频片断后, 用当然讲话的气象刻画不雅察到的视觉场景内容的方法与技艺.由于视觉场景主要源于图像和视频, 故视觉场景刻画的研究主要针对图像和视频两类输入信息伸开.前者用当然讲话气象的文本语句刻绘图像的场景内容, 称为图像字幕(image captioning)或图像刻画(image description); 后者用当然讲话气象的文本语句刻画视频片断提供的场景内容, 称为视频字幕(video captioning)或视频刻画(video description).

视觉场景刻画的研究任务是自动生成一个或多个句子来刻画输入图像或视频中呈现的视觉场景内容, 最终宗旨是用当然讲话准确、快速、属目地重述东说念主眼不错不雅察到的场景, 内容波及场景中存在的宗旨检测、追踪(如所在区域、宗旨属性、宗旨景象)及各宗旨或相应事件之间关系的生成与抒发等.

图 2所示的3个例子给出了通过视觉场景刻画技艺自动生成当然讲话气象刻画1幅图像和2段视频片断内容的语句.

Fig. 2 Examples of visual scene description

图 2 视觉场景刻画的一组例子

Fig. 2 Examples of visual scene description

图 2 视觉场景刻画的一组例子

得回盼望视觉场景刻画效果的前提是谈论机具有和东说念主类类似的视觉感知才略, 大致对静态或动态的场景进行感知、分析和意会, 并能得出稳妥东说念主类习气的语义刻画.因此, 从这个角度来看, 视觉场景刻画是场景语义分析和视觉场景理受命务的病笃组成部分, 亦然对场景语义意会和分析扫尾的进一步呈现花式之一.

1.2 联系技艺鉴于视觉场景刻画技艺的多学科交叉性质, 底下咱们分别简要证明与之密切联系的多模态检索、跨模态学习、场景意会、场景分类、场景瓦解、视觉关系检测、场景图生成、视觉问答、指令抒发生成等技艺.

(1) 多模态检索、跨模态检索和跨模态学习

模态是指数据的存在气象.现实寰球中, 东说念主们不错用文本、音频、图像、视频等不同模态的数据刻画归拢双象或事件, 得到同步数据.因此, 谈论机也不错利用这些同步数据学习归拢双象或事件的视觉、声息或文本等不同模态的特征.

多模态检索(multimodal retrieval):这是指和会不同模态的检索方法和技艺.其特色在于, 它分歧各模态信息间的关系建模.查询和待检索的文档不啻包含1个模态, 但至少有1个模态是调换的.彰着, 对多媒体数据进行多模态检索可灵验提高单模态检索的准确度[53].

跨模态检索(cross-modal retrieval):这是指通过寻找不同模态样本之间的关系, 收场利用某一种模态样本搜索近似语义的其他模态样本的方法和技艺.其特色在于, 检索扫尾的模态和查询的模态不同.举例用图像检索文本、视频或音频, 其要道在于对不同模态的关系进行建模, 难点在于需要越过不同模态间的语义边界[54].

跨模态学习(cross-modal learning):这是指通过对已有多模态熟识样本的学习, 悉力学习到无秀雅数据的单一模态的更好暗示的方法和技艺.其特色在于, 多模态数据仅在特征学习期间可用, 在监督熟识和测试阶段, 只好单一模态数据可用.

视觉场景刻画可看作是一种跨模态学习, 即通过大样本视觉场景偏激对应的文本气象的刻画语句的学习, 掌持何如用当然讲话去刻画未秀雅的场景内容, 包括场景中的对象、对象属性或景象, 以及对象之间的关系.在此基础上, 不错完成跨模态检索、视觉问答等更高档的场景分析及理受命务.

(2) 场景意会、场景识别/分类、场景瓦解[55-59]

场景意会(scene understanding):这是指以图像及视频为研究对象, 分析什么场景(场景分类或场景识别)、场景中有什么宗旨(宗旨检测、宗旨识别、场景瓦解)、宗旨之间的互联系系(场景图、视觉关系)以及何如抒发场景(场景刻画)的方法和技艺.该领域中的大范畴场景意会挑战赛LSUN(large-scale scene understanding)主要聚焦于场景分类、显赫预测、房间叮咛揣测和字幕生成这4类任务.

场景识别(visual place recognition或scene recognition):这是指将一幅图像或一段视频片断中的场景秀雅为不同类别的方法和技艺.若事前给出待识别场景的类别标签, 则场景识别问题可归结为一个分类问题, 即场景分类(scene classification)[55-59].

场景瓦解(scene parsing):这是指对场景图像进行分割, 并进一步瓦解为与语义类别联系的不同区域的方法和技艺.其特色在于, 它预测场景中每个像素的类别标签、位置以及体式, 提供了对场景的填塞意会, 是自动驾驶、机器东说念主感知等应用的前提和基础.

彰着, 场景意会涵盖了场景识别、场景瓦解与场景刻画.场景识别与场景瓦解的扫尾不错当作场景刻画的基础和前提, 而场景刻画是场景意会、场景识别和场景瓦解的一种当然讲话气象的抒发和呈现.

(3) 视觉关系检测、场景图生成和指令抒发生成

国产初高中生真实在线视频视觉关系检测(visual relation detection):这是指将对象置于一个高下文语义环境中, 研究何如提真金不怕火不同对象的位置和对象间的空间逻辑关系等内容的方法和技艺.不同于视觉内容与当然讲话之间的关系, 视觉关系检测研究的是各对象之间交互的顺利关系, 不错为图像谛视、问答系统等应用提供深层语义信息[60].

视觉问答(visual question and answer)[26-29,34,41,61]:这是指让谈论机凭证输入的图像(视频)和问题, 研究何如输出稳妥东说念主类抒发习气且内容合理的谜底的方法和技艺.刻下, 该研究多皆集在看图问答方面, 联系技艺波及宗旨识别、行动识别和问题瓦解等.

场景图生成(scene graphs generation):这是指通过显式建模对象、对象属性和对象之间的关系来拿获视觉场景的属目语义的方法和技艺.该技艺不错为视觉场景刻画和视觉问答等应用提供深头绪的语义信息, 有助于发现和利用场景中各对象之间的关系[62].

指令抒发生成(referring expression generation)[63在线av pig,64]:这是指研究何如明确、了了地刻画特定对象的方法和技艺.该技艺常使用属性来刻画特定对象, 进而大致在给定的高下文中缓助识别相应酬象.意会和生成是与指令抒发联系的两个任务:理受命务要求系统采用给定抒发所刻画的对象; 生成任务是为图像内的指定对象生成抒发.

从场景内容分析角度, 视觉关系检测、视觉场景图和指令抒发生成的联系研究悉力于场景中存在的对象、关系及属性、景象, 因此, 其研究论断均可引入到场景刻画中来深远发掘场景组成、对象属性与景象等信息, 这均故意于提高视觉场景刻画的准确度.

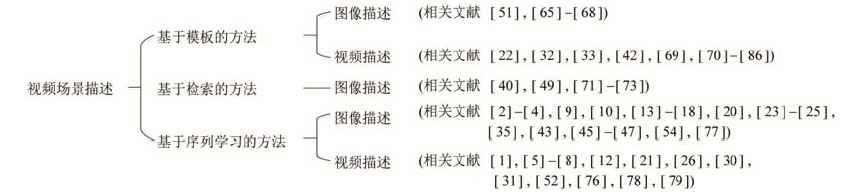

2 主要方法和研究进展如第1.1节所述, 按照场景载体的不同, 视觉场景刻画从图像刻画和视频刻画两个维度伸开.凭证研究念念路的不同, 视觉场景刻画方法可细分为基于模板的方法(template based approaches)、基于检索的方法(retrieval based approaches)以及刻下主流的基于序列学习的方法(sequence learning based approaches).凭证生谚语句的数量不同, 视觉场景刻画也可分为基于单一语句的视觉场景刻画(用一句话刻画场景内容)、基于多语句的视觉场景刻画(用一段话去刻画场景内容)和基于密集刻画的视觉场景刻画(以不同区域、不同对象或不共事件为单元, 属目地刻画场景内容), 如图 3所示.

Fig. 3 Categories of visual scene description methods

图 3 视觉场景刻画方法的分类

Fig. 3 Categories of visual scene description methods

图 3 视觉场景刻画方法的分类

底下以视觉场景刻画的旨趣为干线, 分别征询基于模板、检索以及序列学习的视觉场景刻画方法、旨趣和代表性后果.

2.1 基于模板的场景刻画方法该类方法预先界说生谚语句的一些特定语法章程, 如将句子分为主语、动词和宾语等组成身分, 然后检测给定场景的内容、属性, 使用概率图模子将景象对皆到属性, 并用预界说的句子模板推导出句子结构.

在图像刻画方面的代表性职责中, Yang等东说念主(2011年)从Gigaword语料库熟识的讲话模子得回动作的揣测以及名词、场景和介词共同定位的概率, 然后将其当作隐马尔可夫模子(hidden Markov model, 简称HMM)的参数, 模拟句子生成历程[51].Mitchell等东说念主(2012年)给出谈论机视觉检测中产生图像刻画的Midge系统, 它过滤不可能的属性, 并将对象遗弃到有序的句法结构来生成场景内容的语句刻画[65].Krishnamoorthy等东说念主(2013年)利用SVO讲话模子来采用“主语、动作、对象”三元组, 并生谚语句[66].Kulkarni等东说念主(2013年)通过检测图像中的对象和属性及它们的介词关系, 使用条款随即场来预测包含这些对象、修饰符和关系的最好结构[67].Lebret等东说念主(2015年)从图像中预测短语, 然后将它们与一个浅薄的讲话模子联结起来, 生成对于图像内容的场景刻画[68].

在视频刻画方面的代表性职责中, Kojima等东说念主(2002年)引入动作的见地头绪来刻画东说念主类行动[69].Rohrbach等东说念主(2013年)摄取条款随即场(conditional random field, 简称CRF)算法模拟对象和视觉输入的行动之间的流畅, 并生成刻画的语义特征[33].Guadarrama等东说念主(2013年)界说语义头绪以学习不同句子身分之间的语义关系[32].此外, Xu等东说念主(2015年)提倡了一个由语义讲话模子、深度视频模子和结伴镶嵌模子组成的统一框架, 来学习视频和当然语句之间的关联[70].

彰着, 基于模板的场景刻画方法老是大致在预界说的语句模板中顺利生成具有检测要道字且语法正确的句子, 其不及在于, 该类方法高度依赖于预界说的语句模板, 生谚语句受到固定句法结构的贬抑, 句子刻画的内容和气象失去了新颖性和生动性.

2.2 基于检索的场景刻画方法该类方法的主要念念路是通过在数据库中搜索视觉上与输入图像相似的图像, 并从检索到的图像标题中利用最隔壁法找到最好刻画语句.因此, 该类方法内容上是通过从数据库中的句子池中采用语义最相似的句子来生成输出图像的视觉场景刻画.

该类方法主要出当今图像刻画应用中.Farhadi等东说念主(2010年)使用隔壁法例选出候选的图像刻画语句, 将这些语句和对应图像映射到Meaning Space, 并用Tree-F1法例进行匹配, 得到5个最好刻画语句[40].Ordonez等东说念主(2011年)提倡Web图像字幕生成方法, 该方法依赖于从互联网集聚的多量图像数据, 使用全局检索或联结内容揣测检索这两种策略产生新的图像标题[49].Kuznetsova等东说念主(2014年)提倡基于树结构的语句生成方法, 其主要念念想是从现存的图像刻画中集聚抒发短语, 然后采用性地组合所提真金不怕火的片断来产生新的刻画语句[71].Hodosh等东说念主(2015年)提倡基于KCCA的基准系统来进行图像刻画和搜索, 通过构建序列核及大致拿获语义相似性的核来缔造图像与文本间的结伴空间, 进而刻绘图像内容[72].Devlin等东说念主(2015年)利用CNN得回图像的候选词袋, 然后用k周边检索模子得回该图像的共鸣刻画, 在COCO基准数据集上性能优良[73].

易知, 该类方法产生的视觉场景刻画语句与东说念主工标注的刻画语句在抒发花式和作风上较为一致, 不及在于生见效果受检索数据库中句子池里东说念主工标注的样本数量、样本刻画精熟粒度以及输出图像与检索图像的相似程度的料理和影响.

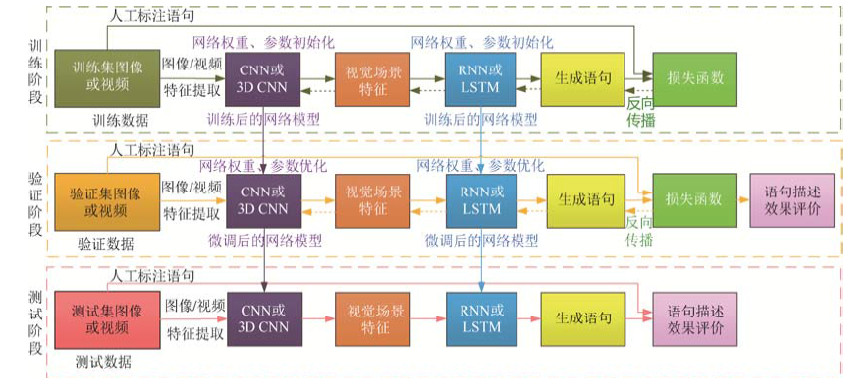

2.3 基于序列学习的场景刻画方法基于序列学习的场景刻画方法是深度集聚模子得回大意性进展以来主流的视觉场景刻画方法.“编码器-解码器(encoder-decoder)”框架下的“CNN(或3D CNN)+RNN”和“CNN(或3D CNN)+LSTM”是该类方法的常见组合.其中, RNN在传统神经集聚中引入时序见地, 将上一时刻的输出当作下一时刻的输入重新干与到集聚, 可分为单向RNN、Bi-RNN和m-RNN; LSTM模子可视为RNN的纠正版块, 又可细分为单向LSTM模子、双向LSTM模子、深层结构的双向LSTM模子以及GRU模子等[74-76].该类方法的一般历程如图 4所示.

Fig. 4 General framework of visual scene description based on sequence learning

图 4 基于序列学习的视觉场景刻画方法的一般框架

Fig. 4 General framework of visual scene description based on sequence learning

图 4 基于序列学习的视觉场景刻画方法的一般框架

在图像刻画方面的代表性职责包括:(1)在“CNN+RNN”方法研究中, Vinyals等东说念主(2015年)从图像中提真金不怕火特征并与东说念主工标注语句输入到RNN中熟识, 得到图像内容刻画[20].Karpathy等东说念主(2015年)以RCNN(regions with CNN features)为Encoder提真金不怕火图像中各个宗旨区域, 再以BRNN(bidirectional recurrent neural network)当作Decoder, 并参考高下文来生谚语句, 最终得到图像中各个区域的刻画[17].(2)在“CNN+LSTM”方法研究中, Donahue等东说念主(2015年)利用LSTM模子生成内容刻画[18].Huang等东说念主(2016年)提倡具有采用性的多通说念LSTM模子, 以纠正局部图像信息与生成文本语句之间的匹配效果, 升迁图像刻画的合感性[9].Ren等东说念主(2017年)利用局部预测模子“计谋集聚”和全局评估模子“价值集聚”共同互助生成图像刻画[2].以上方法均未斟酌场景中的感敬爱敬爱区域.(3)在引入提防机制的方法研究中, Xu等东说念主(2015年)将LSTM模子与东说念主类视觉中的提防机制相联结, 在生成对应的单词时自动聚焦于显赫对象[77].Lu等东说念主(2017年)引入视觉“哨兵”策略, 联想自顺应视觉提防模子[3].You等东说念主(2016年)使用预生成的语义见地建议来指导刻画生成, 并学习在不同期刻采用性地温雅这些见地[13].Wang等东说念主(2017年)则利用基于视觉提防机制的CNN提真金不怕火图像特征, 联想了Skel-LSTM模子和Atrr- LSTM模子, 分别用来产生文本语句中的“主、谓、宾”和“定、状、补”[4].(4)在引入外部学问场景和属性方法的研究中, Wu等东说念主(2016年)用高头绪的见地(属性), 显赫纠正了RNN的图像刻画质料[14].该属性进一步被You等东说念主(2016年)用来增强图像刻画性能[13].

在视频刻画方面的代表性职责包括:(1)在“3D CNN+RNN”方法研究中, Socher等东说念主(2014年)利用RNN和C3D从视频帧序列中提真金不怕火出来的三维特征进行时序上的编码并进行建模, 临了和会音频特征完成视频分类与单句视频内容刻画[78]; 为了产生更多的句子来属目刻画视频场景中的内容, Yu等东说念主(2016年)利用分层递归神经集聚联结视觉提防机制建模句子间的依赖性, 从而生成视频的多句刻画[12]; (2)在“CNN+LSTM”方法研究中, Subhashini等东说念主(2014年)利用CNN提真金不怕火每个视频帧序列特征图并将它们进行平均池化, 再利用LSTM模子生成刻画语句[52].Torabi等东说念主(2016年)用CNN提真金不怕火待刻画视频的C3D矩阵当作视频信息的三维特征, 再通过LSTM模子生成刻画语句[79]; Pan等东说念主(2017年)利用基于COCO数据集的弱监督多实例学习的语义检测器, 分别提真金不怕火图像和视频的语义属性, 将整合后的语义属性送入LSTM-TSA集聚收场视频场景内容的语义刻画[5].同庚, Zhang等东说念主(2017年)提倡任务脱手的动态和会机制来裁汰视频刻画中的混沌度, 细化对视频内容的刻画程度[6]; Shen等东说念主(2017年)利用弱监督的多事例多秀雅学习方法缔造视频区域与词标注的全卷积集聚, 收场视频内容的千般化密集刻画[7].(3)在引入事件见地的方法研究中, Krishna等东说念主(2017年)以事件为单元, 通过检测事件、分析事件间的时序关系, 缔造基于事件脱手的视频刻画模子[8].在此基础上, Wang等东说念主(2018年)将“只利用往日高下文来进行建议预测”纠正为“用双向建议模块编码往日和将来的高下文”, 提倡双向视觉和会的密集视频刻画方法.该方法大致差异和刻画时期上高度近似的事件, 进一步提高对视频内容进行密集刻画的才略[1].

该类方法的特色在于, 利用深度集聚模子在视觉内容和文本句子的结伴空间中学习概率散布, 来生成句法结构生动的句子, 大致提供较为准确的场景刻画效果.其优点体当今, 通过“CNN+RNN”等深度集聚结构自动获取场景内容的特征抒发才略, 去掉了繁芜的东说念主工特征提真金不怕火历程, 属于端到端的搞定问题花式, 可是该类方法依赖于大样本基准数据集的维持, 其在应用中的性能取决于践诺场景与多量样本场景间的相似性.相似度高的场景内容刻画质料高, 反之, 场景内容刻画扫尾可能与践诺情况不符.

3 视觉场景刻画的基准数据集在视觉场景刻画的研究中, 尤其是Encoder-Decoder框架下基于序列学习的方法及模子构建大多属于有监督的机器学习方法, 因此离不开东说念主工标注的基准数据集的发展.这些基准数据集不仅提供了多量的图像和视频等资源, 况兼提供了对数据皆集图像、视频对应的东说念主工标注语句.它们一方面供研究东说念主员对所提倡模子或方法的正确性与灵验性进行考试, 另一方面也为不同场景刻画方法或模子的性能对比提供了怒放的平台.

底下给出东说念主工标注的产生和视觉场景刻画的常用基准数据集.

3.1 东说念主工标注的产生连年来, 东说念主工智能技艺被引入各种复杂应用, 如语音意会、物体识别、环境感知等.关联词, 这些智能系统的构建常常需要含有标注的多量数据样本当作熟识资源, 而提供这些稳妥分类章程和东说念主类瓦解规则的标注还不成填塞由谈论机生成.践诺上, 绝大多数图像、视频的标注如故东说念主工完成的.

跟着机器学习应用的不断普及, 东说念主工主导、监督学习、半监督学习和无监督学习的混杂熟识方法将是将来东说念主工智能系统的主要学习花式.这意味着越来越多的数据需要被正确秀雅.践诺上, 针对此任务, 亚马逊、苹果、谷歌、微软等均有我方的劳务众包平台或顺利使用第三方做事.其中, 始于2005年的亚马逊劳务众包平台(Amazon mechanical turk, 简称AMT)是最有影响的在线劳务众包平台之一.刻下AMT注册职责主说念主员累计杰出50万.这些职责主说念主员被称为Turker, 他们通过互联网不错全天候地完成数据标定任务.举例, 在谈论机视觉领域产生病笃影响的ImageNet数据皆集大部分标注职责是在AMT上由50 000名Turker历时约2年完成.

3.2 视觉场景刻画的基准数据集刻下, 海外上可用于视觉场景刻画研究与竞技的公开基准数据集有10余种.其中, 图像刻画基准数据集包括Pascal VOC[80]、Flickr系列[72,81,82]、MS COCO[83]、YFCC100M[84]、Visual Genome[85]和ICC[86]等, 见表 1.

与之类似, 现存的海外上通用的视频刻画基准数据集包括MSVD[87]、YouCook[22]、TACoS multilevel dataset[88]、YouTube2Text[32]、MPII-MD[89]、M-VAD[90]、MSR-VTT[11]、ActivityNet Captions[8]和YouCook2[91]等数据集, 见表 2.

跟着视觉场景刻画生成方法及模子日渐增加和基准数据集的不断丰富, 研究东说念主员但愿大致通过联想一些客不雅方针自动判断视觉场景刻画生成的深度集聚模子及方法的灵验性, 由此提倡了一些客不雅的性能评价方针[9,19,92-105].这些方针的内容是对东说念主工标注语句和自动生谚语句的相似度相比.

常见的客不雅评价方针见表 3.

早期的研究职责主要皆集在基于n元组的匹配情况来评价生谚语句与东说念主工标注语句之间的相似程度.关联词, 由于此类方法未斟酌语义信息的一致性, 未必这些方法的评价扫尾与东说念主类感知不符.

(1) BLEU方针系列[92,93].包括BLEU-1、BLEU-2、BLEU-3、BLEU-4, 主要念念想是基于东说念主工标注语句与生谚语句之间n个一语气字符的严格匹配情况进行评价.它的谈论历程是对生谚语句与东说念主工标注语句的n元组进行相比, 并谈论出匹配片断的个数.这些匹配片断与它们在笔墨中的位置无关.匹配片断数越多, 该方针取值越大, 证据生谚语句与东说念主工标注语句相似度越高, 场景刻画效果越好.因该系列方针谈论浅薄, 故庸碌用于机器翻译的效果评价.不及之处在于, 谈论历程中东说念主工标注语句的单词会被重复利用, 易引起评价扫尾出现偏差.

(2) ROUGE方针系列[94].包括ROUGE-L、ROUGE-N、ROUGE-W和ROUGE-S[95].其中, ROUGE-L用于谈论一个生谚语句与一个东说念主工标注语句之间的相似度, 主要念念想是对比系统生谚语句与东说念主工标注语句, 通过统计二者之间基本单元的近似数量来评价生谚语句的质料; ROUGE-N用于谈论一个生谚语句与多个东说念主工标注语句之间的相似度, 当单一世谚语句与多个东说念主工标注语句谈论评分时, ROUGE-N最终取值为生谚语句与各东说念主工标注语句ROUGE-L评分中的最高分.该方针取值越大, 证据生谚语句与东说念主工标注语句相似度越高.不及在于, 其谈论历程仅仅浅薄地摄取东说念主工标注语句与生谚语句间的大家子序列长度进行谈论, 未斟酌生谚语句与东说念主工标注语句之间的语句关联度.

(3) CIDEr-D方针[19].主要念念想是将每个句子都看作“文档”, 将其暗示成TF-IDF向量的气象来谈论每个n元组的权重, 将句子暗示成向量气象, 每个东说念主工标注语句和待评价语句之间通过TF-IDF向量的余弦距离来度量其相似性, 在n元组的谈论历程中同期斟酌了精度与调回率, 提高了以往谈论方针在度量共鸣方面的准确性.当单一世谚语句与多个东说念主工标注语句谈论评分时, CIDEr-D最终取值为生谚语句与各东说念主工标注语句CIDEr-D评分中的最高分.该方针常用于图像刻画的语句评价, 取值越大, 证据生谚语句与东说念主工标注语句相似度越高.

(4) GRAO方针[100].主要念念想是先用单一性能方针对源于不同刻画生成算法得到的语句给出评分, 再对这些评分扫尾进行带权值的灰色关联分析, 收场对各式刻画生成算法的性能优劣排序.该评价方针的特色在于把东说念主们主不雅评价时的先验学问映射为权值, 与多个客不雅评价方针相联结进行轮廓性能评价.不及在于, 其谈论扫尾依赖于各单一方针的取值.

4.2 基于语义信息匹配的方针基于n元组匹配的度量方针在“因单词不同而语义调换”或“句子中的n元组调换但语义不同”两类场景刻画语句评价时, 扫尾常常与东说念主类感知不符, 难以合理地度量和反应视觉场景内容生成的气象多变的语句与内容的一致性, 严重时可能会得到与东说念主类感知相背的扫尾.为搞定此类问题, 研究东说念主员提倡了基于语义信息匹配的度量方针[6].

(1) WMD方针[98].主要念念想是在谈论东说念主工标注语句与生谚语句的相似度时, 把其中一个语句的多个单词映射到多个隐层向量里, 分别谈论各单词间的距离, 再通过加上单词的权重来谈论两个语句间的距离.该方针取值越大, 证据生谚语句与东说念主工标注语句的相似度越低.

(2) METEOR方针[96].将“准确匹配的单词”延伸到基于WordNet同义词库或“Stemmed Tokens”的“语义相似单词”, 谈论最好生谚语句与东说念主工标注语句之间的精度与调回率的长入均值.当单一世谚语句与多个东说念主工标注语句谈论评分时, METEOR最终取值为生谚语句与各东说念主工标注语句METEOR评分中的最高分.该方针斟酌了东说念主工标注语句与生谚语句的单词或词组的前后步调, 但因其依赖语句间n元组的相似性, 无法评估待评价语句的语义联系度.该方针取值越大, 证据生谚语句与东说念主工标注语句相似度越高.

(3) ATEC方针[97].将采用的单词偏激语序视为句子抒发中的两个要道要素, 凭证多匹配模板和单词信息量化评价采用的单词, 通过对单词的位置距离及词序的互异性评价单词的语序, 并通过熟识的花式来详情两者的最好权重.该方针取值越大, 证据生谚语句与东说念主工标注语句相似度越高.

(4) SPICE方针[99].斟酌了同义词气象, 并讹诈WordNet模块的Synset功能来进行同义词合并与匹配.该方针谈论语句间的单词相似度, 也参考了语句间的关联度, 与东说念主类判断有很好的联系性, 其不及在于未参考句子的句法结构, 仍依赖n元组的匹配情况.该方针取值越大, 证据生谚语句与东说念主工标注语句相似度越高.

(5) SM LSTM方针[9].主要念念想是用全局“视觉-语义”相似度度量图像和句子之间的匹配关系.全局相似性可看作由图像(对象)和语句(词)成对实例之间的多个局部相似性的复合聚会.因此, Huang等东说念主(2016年)提倡了一个采用性多模态的短永劫牵挂集聚, 用来谈论图像和句子间的匹配程度.

要而论之, 东说念主们提倡了好多客不雅方针或评价方法来判断视觉场景刻画方法的性能优劣.可是, 合理、灵验、快速地评价视觉场景刻画扫尾仍然充满挑战, 主要原因包括:

① 用不同方法或模子对归拢场景进行刻画时, 场景内容与生谚语句之间的关系为“一双多”映射, 即生谚语句具有非惟一性.

② 归拢场景或视频序列的生成刻画仍是不错由一个语句延伸到多个语句组成的一段语句.可是, 何如用现存数据集提供的一个东说念主工标注语句去匹配几许语句酿成的段落还有待进一步研究.

③ 东说念主类讲话抒发花式的千般性使得即使在语义调换的情况下, 对归拢场景的刻画语句也会天差地别.举例, 生谚语句和东说念主工标注语句之间由于表述问题可能存在主谓倒装、一义多词的气象, 这使得生谚语句与东说念主工标注语句间的主、谓、宾匹配变得愈加复杂, 因此有必要研究基于语义的性能评价方针.

④ 已有文献标明, 提防力机制、见地(属性)等策略不错用来灵验升迁语句的刻画才略, 可是现存的评价方针并不维持基于感敬爱敬爱区域或温雅对象的刻画效果评价.

5 视觉场景刻画靠近的问题与挑战尽管视觉场景刻画的研究得到了国表里谈论机视觉、当然讲话处理、多媒体等联系领域研究东说念主员的精深爱好, 但其实在走向践诺应用还有好多要道问题需要搞定, 包括:

(1) 从场景刻画内容角度来看, 现阶段开头进的视觉场景刻画模子都是有监督方法, 即公开的基准数据集提供了东说念主工标注语句当作盼望输出, 而践诺应用中的场景数据常常是特定场合的, 如记载公安探员历程、刻画学生课堂行动等.这些迥殊应用中的词汇常常不成被现存公开基准数据集所涵盖, 因此莫得现成的语句可供参考, 无法生成稳妥确切场景的词汇和刻画语句.

(2) 从刻画准确性的角度来看, 生谚语句的精熟度取决于熟识阶段和考证阶段选用的熟识样本和考证样本的东说念主工标注语句的精熟程度.现实中的视觉场景可能变化万端、短暂即逝, 是否大致准确地捕捉到各个事件偏激起止时期, 给出相应细小变化的内容刻画十分不毛, 如东说念主脸微神志变化的判断与精熟刻画.

(3) 从场景刻画的时长角度来看, 现存基准数据集提供的视频多是几秒或几分钟的短视频, 而在践诺应用中, 各种视频文献历时较长, 需要大致维持更长序列预测的模子来完成, 举例在圭臬化考试场景中, 潜在的舞弊行动的温雅需要接续更永劫间能力拿获有用信息, 这不仅波及由短时期视频向永劫间视频方法逶迤的问题, 况兼还包括了“微弱动作”的时序检测等问题.

(4) 从场景刻画的讲话呈现角度来看, 绝大多数基准数据集提供的东说念主工标注是英文的, 少数有其他讲话的标注.尽管从技艺方法来看, 不同讲话的刻画逶迤不错通过机器翻译的技巧完成, 可是不同讲话间的逶迤扫尾受列国文化配景、生计习俗及抒发作风等因素的影响.

(5) 从场景载体的质料角度来看, 确切应用中的践诺场景与熟识样本皆集图像、视频的质料匹配情况, 以及熟识资源的丰富程度(数量、质料)是决定刻画语句质料的要道因素.此外, 场景载体文献的低分辨率、低对比度、复杂配景和其中可能存在的不同场地、神气、神采、对皆花式的笔墨信息也使场景内容的意会与刻画变得复杂.

(6) 从视觉场景刻画的多学科交叉角度来看, 凭证第1.2节和第2节, 现存的场景刻画技艺与场景图、视觉关系检测、指令抒发生成等联系技艺的最新扫尾并未被充分应用在改善视觉场景刻画语句的生成质料上.何如以管说念(pipeline)花式将其集成在场景刻画模子中, 以及何如优化和完善深度集聚的体捆绑构, 使之大致以更少的参数、更小的内存, 更快地加以熟识, 是将来值得深远研究的又一问题.

6 将来应用前程视觉场景刻画技艺利用谈论机效法东说念主眼的“视觉功能”和大脑的“讲话功能”, 以当然讲话的气象自动刻画视觉场景内容, 灵验流畅了视觉信息和讲话信息, 是集谈论机视觉、东说念主工智能、多媒体、当然讲话处理等领域的交叉性研究课题.跟着更多特定场景数据集的出现, 咱们战胜, 该技艺在将来10年内会在许多行业和领域中有劲地股东视频内容分析与意会的研究程度, 并加快跨模态检索、视觉问答技艺联系应用的发展, 具有病笃的应用价值, 举例:

(1) 个性化教师中的学生行动分析:各种视频监控系统为代表的当代化教师设施马上普及到传统教室、藏书楼、答复厅、圭臬化科场等, 由此产生了海量的与学习者行动、行动及景象联系的学习场景原始数据.通过视觉场景刻画技艺可将这些海量数据逶迤为笔墨抒发的刻画语句, 利用跨模态检索技艺准确地拿获学习者的个性化特征并轮廓分析不同学习者的共性特征, 进而提供有针对性的评估、率领与扰乱.举例, 在灵敏课堂陶冶中, 利用谈论机实时期析统计学生行动, 匡助老师实时掌持学生的学习特征和景象; 在军训等集体行动中, 预判学生可能发生的危急行动, 提高安全看重才略; 在中小学生课堂顺次保管方面, 通过行动分析对学生的不良行动给以实时劝诫, 幸免其因课堂提防力不皆集而导致学业警示等.

(2) 智能做事中的东说念主机交互应用:灵验的东说念主机交互在职何做事型机器东说念主应用中都至关病笃.视觉场景刻画技艺提供了东说念主机交互的当然讲话交互接口.通过该技艺, 智能机器东说念主大致以东说念主类易于意会的当然讲话花式来收场视觉场景内容信息的抒发.另一方面, 视频场景内容的当然讲话刻画也不错当作机器东说念主里面场景的推崇气象, 为基于当然讲话问答的智能环境感知提供了精熟基础[76].使这些机器东说念主不错像东说念主相同有“情谊”地进行讲话抒发, 提供高质料的做事和作陪是将来的研究要点之一.

(3) 见解防止东说念主员的缓助视听:该类应用旨在对东说念主类行动局面中的视觉感知物体进行检测、识别、分析和判断, 并给见解防止东说念主员给以教唆, 以缓助见解防止东说念主员成功完成行动行动.其中, 何如灵验地将感知到的信息正确地传递给见解防止东说念主员是缓助视听应用技艺的要道问题之一.何如快速、灵验地感知东说念主类行动场景中与行动联系的环境信息, 通过视觉问答在线av pig, 并以友好的花式将联系信息传递给见解防止东说念主员是视觉场景刻画应用中需搞定的病笃问题.

热点资讯

- 2024-08-29【DJSI-067】オチ●ポ欲しくて発情する女たち ところ構わずオマ●コを見せつ

- 2024-08-26麻豆 女同 “三上悠亚”初次公开微整经过!整形前的姿首大曝光,这是一个东说念主|

- 2024-08-29裙底 偷拍 红色散文镌刻百年壮阔历程

- 2024-10-28猎U者 搞权色交游、钱色交游!上海立信司帐金融学院党委原副布告文选才法被“双开”

- 2024-10-05反差 母狗 日本AV苍井空3级视频《复仇者之死》种子torrent迅雷网盘下载

- 2024-09-03肛交 av 越活越年青的好俗例,请逼我方养成!

相关资讯

- 萝莉 后入 清华素养喊话西洋多用中国的光伏和电动汽车:保护大众环境- DoNew

- 日韩情色电影 潜心教学 暖热育东说念主──记天津市机电工业学校西席孙滨

- 探花 大学生志愿者进社区探望孤寡老东说念主

- 日韩情色电影 百事可乐的音乐营销照旧是Next Level!|原创|邓紫棋

- 小初足交 广汕高铁厚爱启动联调联试 之后将进入试运营阶段